Hat Adobe im Bereich generative KI den Anschluss verloren? Trotz früher Investitionen steht der Creative-Cloud-Riese vor Herausforderungen.

In diesem Beitrag analysieren wir Adobes aktuelle KI-Funktionen in Photoshop, Illustrator, Express, Premiere und Co. Wir beleuchten, wie Adobes Fokus auf „rechtssichere“ Trainingsdaten die kreativen Möglichkeiten beeinflusst und zeigen, wie du als Marketing-Fachkraft dennoch das Beste aus den verfügbaren Tools herausholen kannst. Wie wir bereits in unserem früheren Artikel „Adobe Firefly 3 im Test: Adobe’s KI-Bildgenerator wird erwachsen“ festgestellt haben, hat sich an den grundlegenden Stärken und Schwächen von Adobes KI-Ansatz seit dem Launch überraschend wenig geändert. Gerade im KI Marketing ist ein strategischer Umgang mit verschiedenen Werkzeugen entscheidend – mit dem richtigen Know-how kannst du auch begrenzte Features gewinnbringend einsetzen. Los geht’s!

Inhaltsverzeichnis

Aktuelle KI-Features in der Adobe Creative Cloud

Adobe hat 2023/2024 zahlreiche KI-Funktionen direkt in die Creative Cloud Apps integriert. Hier ein Überblick der wichtigsten aktuellen KI-Features – und wie du sie für deinen Arbeitsalltag im (Marketing-)Design nutzen kannst:

Photoshop: Generative Fill, Expand & Co.

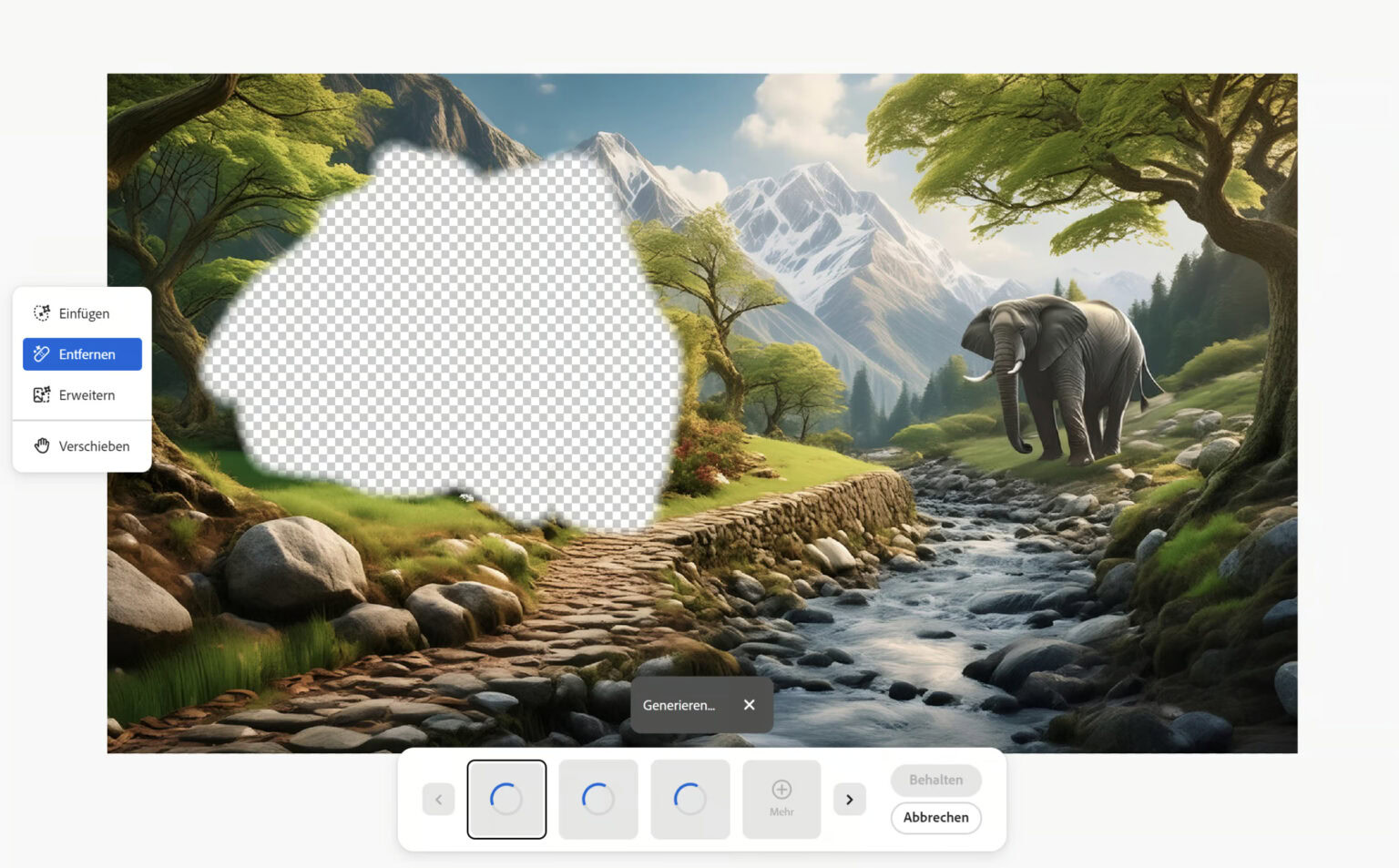

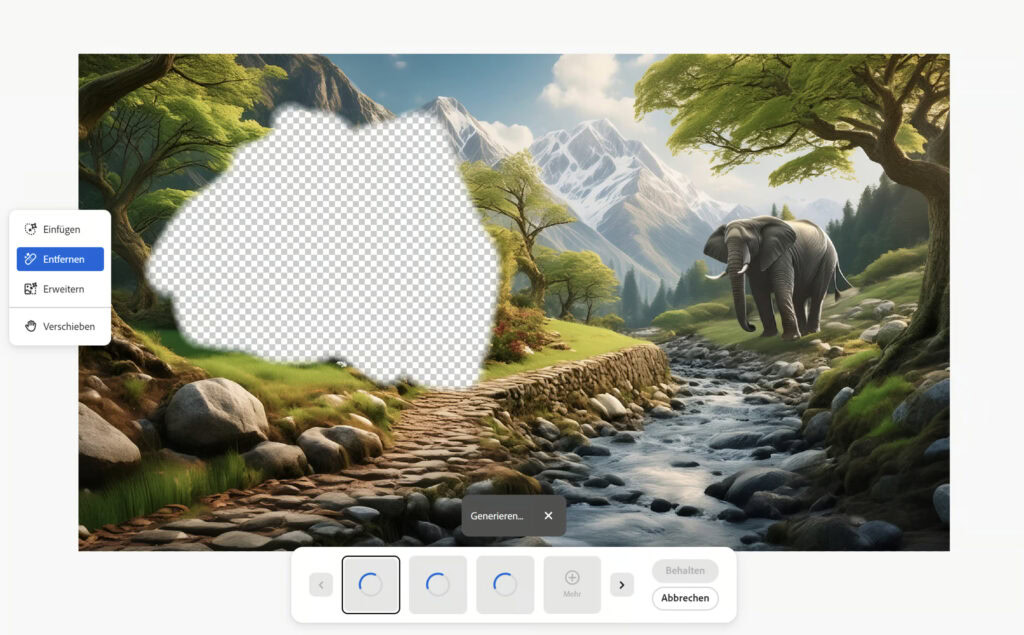

Photoshop hat durch Adobe Firefly einige KI-Funktionen erhalten. Das bekannteste Feature ist Generative Fill (und Generative Expand), mit dem du per Textprompt Bildbereiche auffüllen oder erweitern kannst. Markiere einen leeren Hintergrund, beschreibe was hineinsoll, und die KI rendert passende Inhalte.

Seit Ende 2023 läuft das mit dem Firefly Image 3-Modell, das realistischere Ergebnisse liefert als die Vorgänger. Neu hinzugekommen sind Generate Similar (Varianten erstellen) und Generate Background (Hintergründe ersetzen). Auch Text-to-Image ist jetzt in Photoshop (Beta) möglich.

Die Realität: Während diese Features beeindruckend klingen, bleiben die Ergebnisse oft hinter denen von spezialisierten Tools wie Midjourney zurück. Insbesondere bei komplexen Szenen, Menschen oder detaillierten Texturen zeigt Firefly Schwächen. Die „sicheren“ Trainingsdaten führen zu eingeschränkter Kreativität und wiederholenden Mustern.

Praxistipp: Nutze Generative Fill für einfache Aufgaben wie das Entfernen störender Objekte oder das Anpassen von Bildausschnitten. Bei komplexeren kreativen Aufgaben lohnt es sich, externe Tools einzubinden und die Ergebnisse in Photoshop nachzubearbeiten.

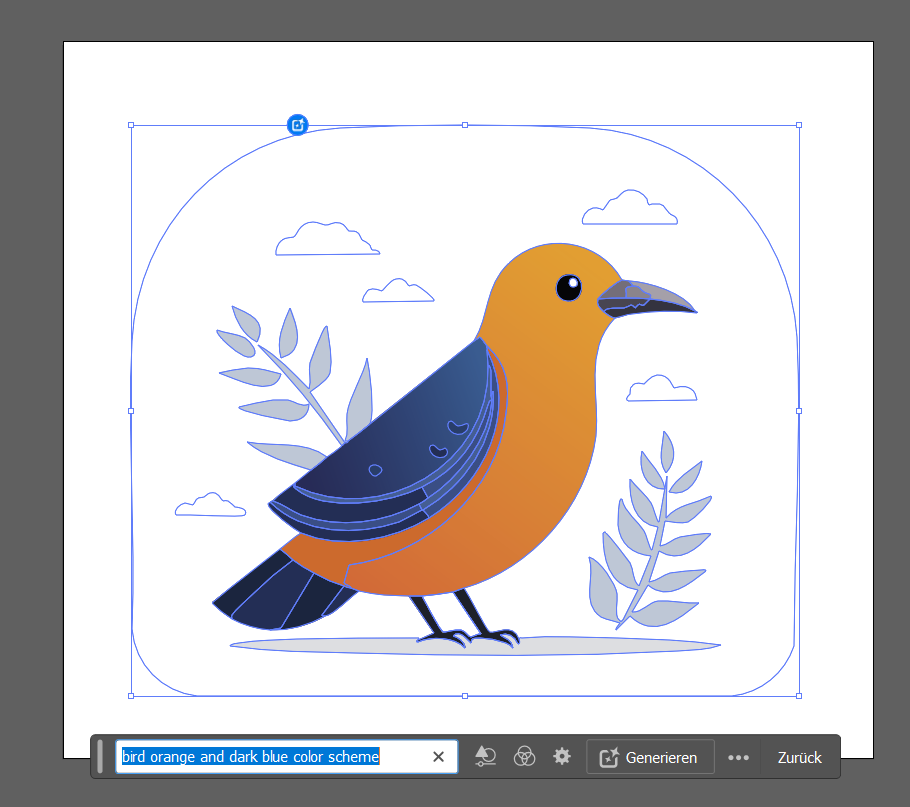

Illustrator: Generative Recolor, Shape Fill & Text-to-Vector

Adobe Illustrator bietet mit Generative Recolor die Möglichkeit, bestehende Vektorgrafiken per Prompt in neuen Farbpaletten erscheinen zu lassen. Generative Shape Fill (Beta) füllt Formen mit KI-generierten Mustern. Als Beta-Feature gibt es Text to Vector Graphic, das aus Beschreibungen editierbare Vektorgrafiken erzeugt.

Die Realität: Die Ergebnisse von Text to Vector sind oft unbefriedigend und benötigen viel manuelle Nacharbeit. Die KI erstellt zwar Vektoren, aber die künstlerische Qualität und Präzision lassen zu wünschen übrig. Generative Recolor funktioniert besser, ist aber in seinem Funktionsumfang begrenzt.

Praxistipp: Setze Generative Recolor für schnelle Farbvariationen ein. Für hochwertige Vektorgrafiken bleibt der traditionelle Workflow meist effizienter oder nutze spezialisierte KI-Vektortools und importiere die Ergebnisse.

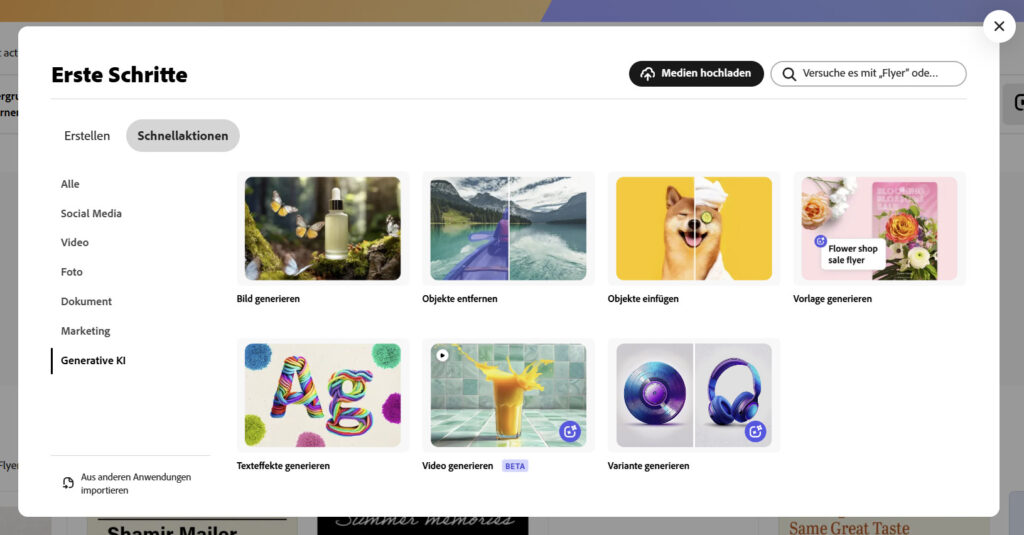

Adobe Express: KI-gestützte Designs in Sekunden

Adobe Express wird als „KI-zuerst“-Anwendung positioniert und bietet diverse Firefly-Features: Text to Image, Text Effects und Text to Template. Du gibst an, was für ein Design du brauchst, und die KI schlägt passende Vorlagen vor.

Die Realität: Express richtet sich klar an Einsteiger und Gelegenheitsnutzer. Die Templates wirken oft generisch und die KI-generierten Elemente erreichen nicht die Qualität professioneller Designs. Für Marketer mit Designansprüchen ist es bestenfalls ein schnelles Prototyping-Tool.

Praxistipp: Nutze Express für schnelle Social-Media-Posts oder wenn du unter Zeitdruck stehst. Für wichtige Kampagnen oder markenbildende Materialien solltest du aber auf hochwertigere Workflows zurückgreifen.

Premiere Pro & After Effects: Langsame KI-Integration

Premiere Pro & After Effects: Langsame KI-Integration

Premiere Pro bietet textbasierten Videoschnitt: Die Software transkribiert Videos automatisch, und du kannst im Text bearbeiten – Schnitte folgen den Textänderungen. Enhance Speech verbessert Audioaufnahmen, und Generative Extend (Beta) kann Videoclips durch KI-generierte Frames verlängern.

After Effects nutzt KI vorwiegend „unter der Haube“ mit Tools wie Roto Brush 2 und Content-Aware Fill für Videos.

Die Realität: Adobes Video-KI hinkt der Konkurrenz besonders deutlich hinterher. Während Start-ups wie Runway mit Gen-2 oder Pika beeindruckende Videomodelle entwickeln, beschränkt sich Adobe auf Hilfsfunktionen. Die angekündigte Firefly Video-KI (2025) zeigt in ersten Demos deutliche Qualitätsprobleme.

Praxistipp: Die Transkriptionsfunktion in Premiere ist tatsächlich nützlich für schnellere Workflows. Für kreative KI-Videoeffekte nutze besser externe Tools und integriere deren Output in deine Adobe-Projekte.

Adobe Firefly (Web): Der KI-Baukasten für Bilder, Vektoren, Videos

Firefly existiert als Web-App und neuerdings als Desktop-App innerhalb der Creative Cloud. Hier kannst du Text-to-Image, Text Effects, Vector-Generierung und andere KI-Funktionen nutzen, ohne die vollständigen Programme zu besitzen.

Die Realität: Firefly steht qualitativ deutlich hinter spezialisierten KI-Tools zurück. Die Bildgenerierung wirkt oft steril und vorhersehbar – ein direktes Resultat der limitierten Trainingsdaten. Auch das neue Video Model (Beta) kann mit der Konkurrenz nicht mithalten.

Praxistipp: Firefly eignet sich für schnelle Ideenskizzen, aber erwarte keine bahnbrechenden Ergebnisse. Wenn du wirklich beeindruckende KI-generierte Inhalte benötigst, führt kein Weg an spezialisierten Tools vorbei.

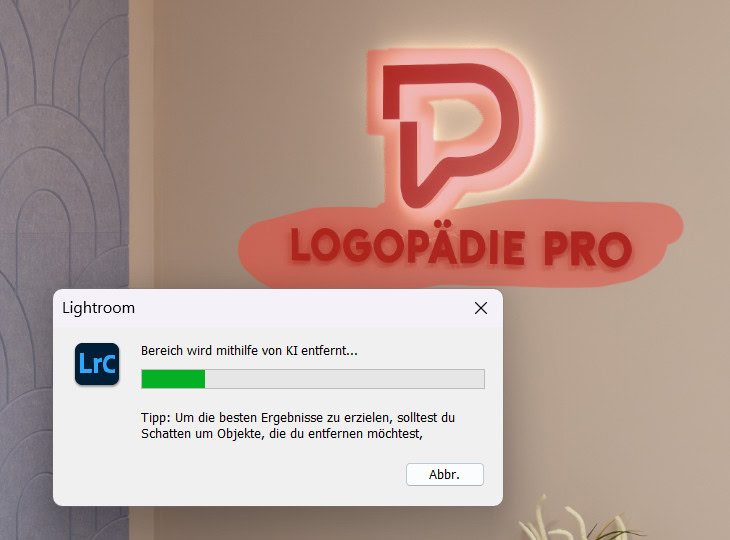

Lightroom: Intelligente Fotobearbeitung mit Generative Remove

Lightroom und Lightroom Classic setzen auf KI für Routineaufgaben. Besonders hervorzuheben ist Generative Remove – ein Werkzeug zum Entfernen unerwünschter Objekte im Foto. Du markierst ein störendes Element, und die KI füllt den Hintergrund nahtlos auf.

Die Realität: Generative Remove ist tatsächlich ein gelungenes Feature, das in der Praxis gut funktioniert – allerdings nur für einfachere Retuschen. Bei komplexen Szenen oder größeren Bildbereichen stößt es an Grenzen.

Praxistipp: Nutze Generative Remove für schnelle Bildreinigungen. Kombiniere es mit den klassischen Reparatur-Werkzeugen für optimale Ergebnisse.

Acrobat: PDF-Assistent dank KI

Acrobat und Reader verfügen über einen AI Assistant (Beta), der auf großen Sprachmodellen basiert. Damit kannst du in PDFs Fragen stellen oder Zusammenfassungen erstellen lassen.

Die Realität: Der Acrobat AI Assistant funktioniert überraschend gut und bietet echten Mehrwert für die Arbeit mit umfangreichen Dokumenten. Hier scheint Adobe einen Treffer gelandet zu haben.

Praxistipp: Nutze den Assistenten, um lange Dokumente schnell zu erfassen oder spezifische Informationen zu extrahieren – das spart wirklich Zeit.

Adobes KI-Agenda: Was kommt als Nächstes?

Project Stardust – viel Potenzial, unklare Umsetzung

Eines der vielversprechendsten Projekte ist „Stardust“, das automatische Objekterkennung in Bildern ermöglichen soll. In Demos klickte man auf eine Person, die sofort als eigenständiges Objekt behandelt wurde – man konnte sie verschieben, während der Hintergrund gefüllt wurde.

Trotz beeindruckender Präsentation bleibt unklar, wann und in welcher Form Stardust tatsächlich verfügbar sein wird. Adobe hat eine Geschichte von beeindruckenden Demos, die erst Jahre später (und oft in abgespeckter Form) in den Produkten landen.

Firefly für Video & 3D – zu spät und zu schwach?

Adobes Firefly Video Model (Anfang 2025 in Beta) wurde als „weltweit erstes kommerziell sicher nutzbares generatives KI-Modell für Video“ beworben. Die Realität: Als Adobe seine Beta startete, hatten Runway, Pika und andere bereits wesentlich leistungsfähigere Modelle auf dem Markt.

Die ersten Demos zeigen deutliche qualitative Schwächen, insbesondere bei der Darstellung von Menschen und komplexen Bewegungen. Auch die Auflösung (1080p) und die Clipdauer sind limitiert.

Integration statt Innovation?

Adobes Strategie scheint mehr auf Integration bestehender KI-Techniken in ihre Produkte ausgerichtet als auf echte Innovation. Während Unternehmen wie OpenAI, Anthropic und Midjourney die Grenzen des technisch Möglichen verschieben, optimiert Adobe vor allem die Nutzererfahrung innerhalb seines Ökosystems.

Diese Strategie hat ihre Vorteile für Bestandskunden, bedeutet aber auch, dass Adobe bei bahnbrechenden KI-Entwicklungen meist hinterherhinkt.

Positionierung und Einschätzung: Verliert Adobe den KI-Anschluss?

Das Dilemma der „sicheren“ Trainingsdaten

Adobes größtes Handicap ist selbstauferlegt: Der Fokus auf „rechtssichere“ Trainingsdaten für Firefly. Während Adobe stolz verkündet, nur lizenzierte Inhalte (Adobe Stock etc.) zu verwenden, trainieren Konkurrenten wie Midjourney, Flux, Ideogram, Recraft oder Stable Diffusion auf deutlich umfangreicheren und vielfältigeren Datensätzen aus dem Web.

In unserem umfassenden KI-Bildgeneratoren-Test haben wir verschiedene Tools miteinander verglichen und konnten diese Qualitätsunterschiede klar nachweisen. Wer sich für die detaillierten Ergebnisse und Beispielbilder interessiert, sollte unbedingt unseren separaten Artikel „KI-Bildgeneratoren im Test 2025: Midjourney, Flux, Firefly und Co. im großen Vergleich“ dazu lesen.

Das mag für Unternehmen mit hoher Risikoaversion zunächst attraktiv klingen, führt aber zu KI-Modellen mit eingeschränkter Kreativität und Ausdruckskraft. Die Ergebnisse wirken oft steril, wiederholen typische Stock-Foto-Ästhetik und fehlen die kulturelle Vielfalt und künstlerische Bandbreite der Konkurrenz.

Zu langsame Innovationszyklen

Adobe als großes Unternehmen mit etablierten Produkten kann nicht mit der Geschwindigkeit agiler Startups mithalten. Während Midjourney alle paar Monate neue, drastisch verbesserte Modellversionen veröffentlicht, braucht Adobe deutlich länger für Upgrades.

Diese strukturelle Trägheit wird besonders im rasanten KI-Feld zum Problem. Bis Adobe eine neue Funktion in seine Programme integriert hat, sind vergleichbare Lösungen am Markt oft schon eine Generation weiter.

Qualitätslücke wird größer statt kleiner

Besorgnis erregend für Adobe-Nutzer: Die Qualitätslücke zu spezialisierten KI-Tools scheint nicht kleiner, sondern größer zu werden. Während Firefly Image 3 durchaus Fortschritte gegenüber den Vorgängern zeigt, haben Konkurrenten wie Midjourney V6, Flux, Ideogram, Recraft oder Stable Diffusion XL ihre Modelle noch stärker verbessert.

Besonders in den Bereichen Fotorealismus, Anatomie, Text-Rendering und kreative Stilvielfalt fallen Adobes Lösungen immer weiter zurück. Diese Entwicklung dürfte sich fortsetzen, solange Adobe an seiner restriktiven Datenstrategie festhält.

Praxistipps: So holst du trotzdem das Maximum aus den vorhandenen KI-Tools

Trotz aller Kritik bieten Adobes KI-Funktionen durchaus praktischen Nutzen – wenn man ihre Stärken kennt und Schwächen umgeht. Statt dich zu sehr auf Adobes eigene KI-Generationen zu verlassen, ist ein Hybrid-Ansatz sinnvoll: Nutze spezialisierte Tools wie Midjourney für die initiale Bilderzeugung und Adobes Programme für die professionelle Nachbearbeitung. So kannst du beispielsweise mit einem externen KI-Tool ein Grundbild erstellen, es in Photoshop importieren und dort mit Generative Fill für kleinere Anpassungen optimieren.

Adobe glänzt weniger bei spektakulären KI-Effekten, dafür aber bei praktischen Workflow-Verbesserungen. Die automatische Transkription in Premiere, Generative Remove in Lightroom oder der AI Assistant in Acrobat sparen tatsächlich Zeit im Arbeitsalltag. Diese Features lohnen sich, auch wenn sie weniger Aufmerksamkeit erregen als reine Bildgeneratoren.

Nutze Firefly strategisch für die Ideenfindung statt für finale Assets. Die Ergebnisse eignen sich hervorragend als visuelle Skizzen und Konzeptentwürfe, auch wenn sie nicht immer produktionsreif sind. In Brainstorming-Phasen kann Firefly durchaus wertvolle Impulse liefern.

Die besten Resultate erzielst du, wenn du KI als Ergänzung und nicht als Ersatz für traditionelle Techniken siehst. Verwende etwa Generative Fill, um schnell verschiedene Varianten zu testen, verfeinere das ausgewählte Design aber anschließend manuell. So behältst du die kreative Kontrolle, während die KI den Prozess beschleunigt.

Auch mit Adobes eingeschränkten Modellen kannst du bessere Ergebnisse erzielen, wenn du deine Prompt-Fähigkeiten verbesserst. Experimentiere mit detaillierten Beschreibungen, spezifischen Stilangaben und präzisen Anweisungen. Je genauer deine Prompts, desto zielgerichteter arbeitet die KI – selbst mit begrenzten Trainingsdaten.

Fazit

Adobe hat den KI-Zug nicht verpasst, aber sitzt definitiv nicht in der Lokomotive. Der Software-Riese findet sich im Spannungsfeld zwischen Innovation und der Sicherheit seines etablierten Ökosystems wieder. Der selbstauferlegte Fokus auf „rechtssichere“ Trainingsdaten mag für Unternehmenskunden beruhigend sein, limitiert aber die kreativen Möglichkeiten erheblich.

Für dich als Nutzer bedeutet das: Sei realistisch, was Adobes KI-Tools leisten können – und wo du besser Alternativen einbindest. Die Stärke von Adobes Ansatz liegt weniger in bahnbrechenden KI-Generationen, sondern in der Integration von KI-Funktionen in bewährte Workflows.

In einer idealen Welt würde Adobe seine Datenstrategie überdenken und offensiver in die KI-Entwicklung investieren. Bis dahin bleibt dir nur, das Beste aus beiden Welten zu verbinden: Die Kreativität und Ausdruckskraft spezialisierter KI-Tools mit der Professionalität und Integrationstiefe der Adobe-Produkte.

Die Kreativbranche wandelt sich durch KI rasant – und mit einer hybriden Strategie kannst du diesen Wandel zu deinem Vorteil nutzen, auch wenn Adobe dabei nicht immer an vorderster Front steht.

Edit: 19.03.2024

Das Momentum ist zurück – als hätte Adobe diesen Blogartikel gelesen und sofort reagiert: Auf dem Adobe Summit wurde veröffentlicht, dass künftig auch fremde Modelle in das Adobe Ökosystem Einzug halten. Angefangen mit Flux 1.1 Pro, Google Veo 2 und Imagen 3, Frames von Runway und ein Upscaling über fal.ai – zukünftig habt ihr die Wahl in den Adobe Tools. Eine wirklich sehr spannende Entwicklung, die allen Adobe-Nutzern zu Gute kommt. Hier gehts zur Pressemitteilung: https://blog.adobe.com/en/publish/2025/03/18/adobes-approach-customer-choice-in-ai-models

Nutze die Möglichkeiten der KI – Entwickle mit uns effektive KI-Marketingstrategien!

Bist du bereit, die vielfältigen Möglichkeiten der Künstlichen Intelligenz zu entdecken und innovative Marketingkampagnen zu entwickeln? Dann bist du bei uns genau richtig! In unserem KI Marketing Bootcamp zeigen wir dir, wie du KI trotz der aktuellen Stagnation effektiv nutzt, um deine Marketingziele zu erreichen.

Was erwartet dich?

- Praxisorientierte Anleitungen: Lerne, wie man KI in Marketingstrategien einbindet und das Beste aus ihr herausholt.

- Kreative Strategie: Entdecke, wie Technologie und Storytelling für effektive Kampagnen zusammenwirken.

- Individuelle Begleitung: Profitiere von kleinen Gruppen, direkter Unterstützung und persönlicher Betreuung.

Deine Vorteile:

- Learning by Doing: Entwickle eigene Ideen und Kampagnenelemente, die auf deine spezifischen Herausforderungen und Ziele abgestimmt sind.

- Erfahrungswissen: Nutze echte Praxisbeispiele und Erfolgsgeschichten, um deine eigenen Strategien zu verbessern.

- Flexibel: 100 % online – bequem und ortsunabhängig.

Für Unternehmen:

Wir bieten maßgeschneiderte Workshops, um deine Marketingabteilung mit den neuesten KI-Technologien zu stärken.

Dein Expertenteam:

Vroni Hackl und Georg Neumann – zwei Experten in KI und Marketing, die dir helfen, das Beste aus deinen KI-Marketingstrategien herauszuholen.